La tecnologia giusta

E dunque il New York Times fa causa a OpenAI e Microsoft per aver usato i suoi articoli allo scopo di allenare la sua intelligenza artificiale senza riconscere un prezzo per l’uso delle opere delle quali detiene il copyright. Il giornale newyorkese chiede un risarcimento di danni per miliardi di dollari. La storia è stata documentata da The Verge.

Dopo molti anni di strategie incerte, alla fine un editore ha il coraggio di chiedere un pagamento adeguato ai produttori di tecnologie. Altri come Cnn, Bbc e altri avevano bloccato il software col quale OpenAI raccoglie gli scritti dai siti che trova online. Altri ancora, come Ap, hanno siglato accordi di licenza dei loro articoli.

Sta di fatto che per come sono progettati, i large language model non sono molto attenti al copyright. È incredibile dato che sono nati nella patria di Disney e di tanti altri fieri combattenti del diritto d’autore. Perché OpenAI e gli altri non ci hanno pensato? È davvero credibile che si siano dimenticati di questo aspetto tanto importante dell’economia della conoscenza? O volevano contestarlo?

Bisogna ammettere che alla nascita Facebook proprio non aveva immaginato di doversi confrontare con la privacy. Poi è stata costretta a farlo. Napster invece non credeva nel diritto d’autore e in qualche misura aiutava gli utenti che lo contestavano o aggiravano. Ebbene: OpenAI è a sua volta disinteressata o contraria al copyright?

Qualunque sia la risposta, si può forse sostenere che la cultura degli imprenditori della Silicon Valley si ritiene al di sopra della legge. Un po’ perché pensa che sia migliorabile, un po’ perché la considera un’interferenza nel progresso tecnologico.

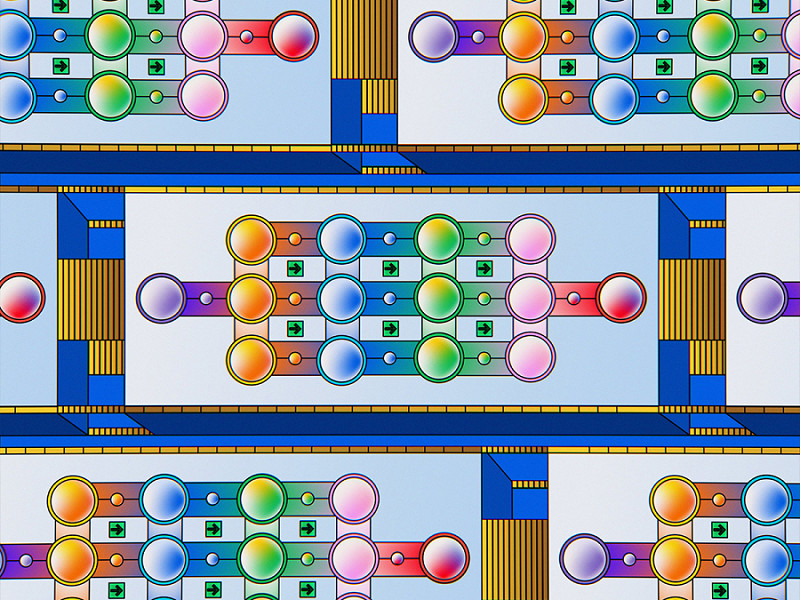

In ogni caso, OpenAI è stata costretta a diventare consapevole del problema del copyright. Lo dimostra il fatto che se si chiede alla chat di spiegare a quali condizioni le immagini da lei generate possono essere usate per fini commerciali, il sistema rifiuta di rispondere e insiste che l’utente deve andare a leggerseli di persona.

Del resto, Claude, di Anthropic, non è aperto in Europa proprio per il timore di cause legali. Il nuovo AI Act tiene conto del tema delle violazioni di copyright da parte dei large language models per limitarne gli eccessi: alla fine del lungo iter di elaborazione del regolamento, l’AI Act potrebbe chiarire i dubbi e favorire le iniziative più consapevoli dei diritti degli utenti fin dalla progettazione. O almeno questo è quello che si spera. Riuscirà questa strategia? La risposta è complessa.

Gli indubbi successi degli americani nell’innovazione sono considerati la dimostrazione che i Paesi nei quali la legge è più importante come l’Europa sono frenati dallo stato nel progresso tecnologico. Ma probabilmente è un’illusione ottica: infatti la Cina, che ottiene ottimi risultati nella tecnologia, è ancora più regolamentata dallo Stato di quanto non sia l’Europa. E comunque lo Stato investitore americano che sostiene il suo avanzamento militare è uno dei motori trainanti dell’innovazione tecnologica del suo Paese.

Insomma non è lo Stato a frenare la tecnologia. Casomai lo è l’esigenza di fare tecnologia nel rispetto dei diritti umani. Ma questo non dovrebbe essere visto come un freno all’inmovazione: dovrebbe essere un incentivo alla ricerca di soluzioni giuste tanto tecnologicamente quanto socialmente. Ce ne sarebbe un enorme bisogno. Ma un fatto è certo: l’epoca delle piattaforme che fanno ciò che vogliono è trascorsa. Un tempo chi si opponeva alle piattaforme appariva vagamente oscurantista. Oggi lo è chi non cerca alternative al loro potere.