Usa: all’AI servono leggi, non autoregolamentazioni

Otto mesi dopo l’esordio di ChatGPT, osservato il balzo di qualità ottenuto con GPT-4 Pitti, qualcuno ha forse avuto l’impressione che la velocità del cambiamento tecnologico nell’intelligenza artificiale abbia leggermente rallentato.

Non è così. Non solo per la moltiplicazione di applicazioni verticali dell’intelligenza artificiale generativa e non solo perché sono nel frattempo uscite alternative come Bard e altre.

Chi conosce quello che sta avvenendo nei laboratori di OpenAI, per esempio, sa che si stanno verificando due dinamiche straordinariamente importanti.

La prima è che si aggiungono moduli cognitivi al modello linguistico per creare correttivi all’output senza dover ricordare a quelle forme di intervento umano sottopagato che sono state necessarie per rendere decenti i risultati dei modelli: per esempio aggiungendo capacità logiche che la statistica linguistica non aveva. Inoltre, a quanto pare, i modelli hanno sempre meno bisogno di dati per allenarsi e imparare.

C’è da aspettarsi dunque che le straordinarie performance delle macchine che abbiamo visto finora saranno superate dalle prossime versioni con grandi balzi di qualità.

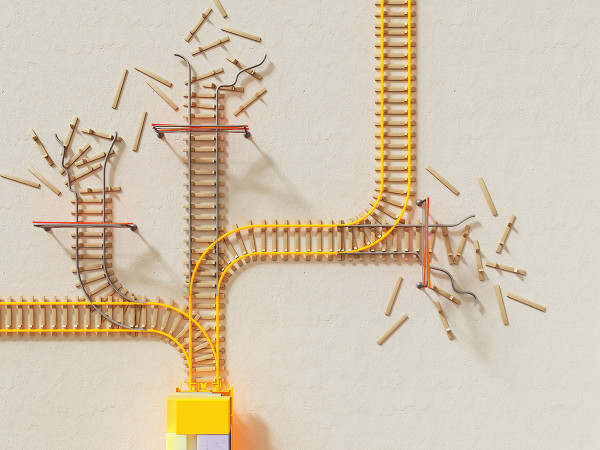

Questa è la sfida fondamentale per la strutturazione di una buona regolamentazione dell’intelligenza artificiale. Non siamo arrivati alla fine delle sorprese tecnologiche.

Nei giorni scorsi alla Casa Bianca tutte le grandi compagnie che fanno intelligenza artificiale si sono impegnate di fronte alla presidenza degli Stati Uniti per garantire la qualità dei loro programmi.

Hanno promesso di far testare le loro intelligenze artificiali prima di immetterle sul mercato. E hanno promesso maggiore trasparenza nei loro programmi e nei modi con i quali i programmi funzionano.

Non hanno ricevuto informazioni sulle normative cogenti (non volontaristiche) che si stanno preparando, ma il presidente americano ha detto che arriveranno attraverso un processo bipartisan. Considerando che stanno arrivando le elezioni presidenziali è difficile che il processo bipartisan porti a risultati più velocemente di quello che sta avvenendo a Bruxelles dove le regole sull’intelligenza artificiale sono già state elaborate e discusse, sicché sono in fondo al processo decisionale.

Gli Stati Uniti vogliono conservare la leadership nel mondo dell’intelligenza artificiale ma non c’è alcun dubbio che non la perderebbero se volessero collaborare con l’Europa per decidere quali norme vanno applicate. In questo modo probabilmente le norme arriverebbero a essere più consapevoli della velocità del cambiamento, meno pericolose per la velocità dell’innovazione, più forti nei confronti delle aziende.