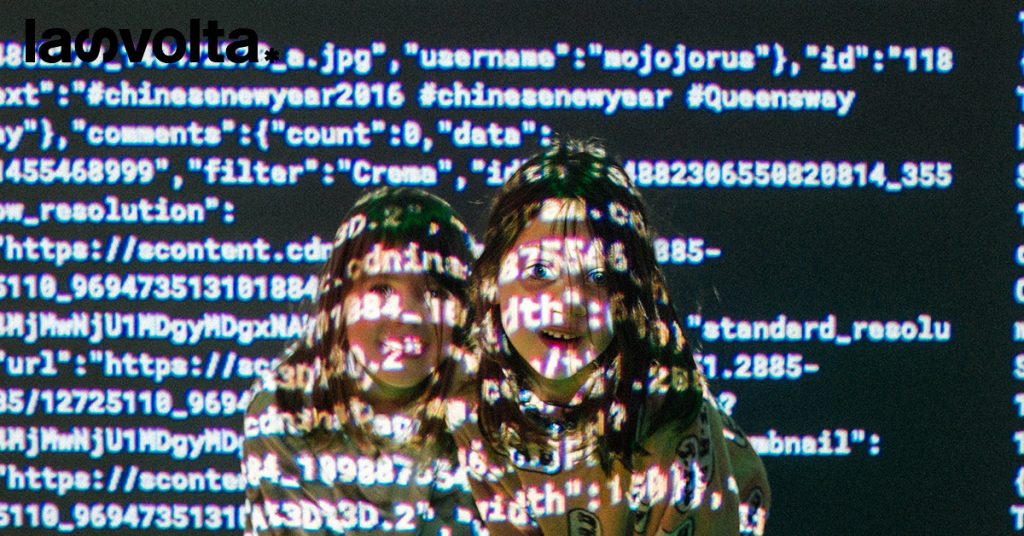

Abusi su minori: aumentano le immagini create con l’Intelligenza Artificiale

Dal 2019sono aumentate dell’87% le segnalazioni di materiale di abusi sessuali sui bambini in rete, che oggi superano i 32 milioni a livello globale. A lanciare l’allarme èWeProtect Global Alliance, tramite il suo ultimo rapportoGlobal Threat Assessment, che ha indagato l’universo della violenza online sui minori. Le forme che assumono gli abusi sono diverse e tra queste,a destare particolare preoccupazione, sono quelle legate all’intelligenza artificiale, tecnologia esplosa in modo significativo nell’ultimo anno, con un potenziale enorme da spendere ma, soprattutto, ancora ricca di terreni inesplorati, falle e pochissimi controlli. Caratteristiche che si tramutano in terreno fertile per i predatori sessuali, soprattutto di minori, che in pochi semplici click sono in grado di creare materiale pedopornografico, spesso senza alcun ostacolo. L’organizzazione internazionaleThornha rilevato che al momento meno dell’1% del materiale di abuso sessuale infantile condiviso in un campione di autori di reati è costituito da immagini fotorealistiche generate al computer di abusi sessuali sui bambini. Tuttavia, anche se si tratta di una percentuale ancora minima, dall’iniziodel 2023 continua ad aumentare il numerodi pedofili che si avvale dell’Intelligenza Artificialee questo fa purtroppo temere che sia solo l’inizio di una salita che, con il passare del tempo, difficilmente diminuirà la sua corsa. Già alcuni mesi fa laBBCaveva svelato che molti pedofili si stavano affidando aStable Diffusionper generare immagini fotorealistiche da diffondere in rete. Il software crea immagini in base alle descrizioni fornite dagli utenti, ma a differenza di Midjourney e altri competitor, grazie alla natura open source del programma riesce a bypassare le restrizioni sui contenuti sessuali normalmente previste. Nonostante, infatti, i programmi di AI più noti siano dotati di sistemi di controllo, esiste un mercato parallelo che sfugge a essi e che risulta molto difficile, al momento, arginare. Per tentare di farlol’Australia, prima a livello globale,ha introdotto misure che impongono alle grandi aziende tech di adottare provvedimentiper garantire che i prodotti di intelligenza artificiale non possano essere utilizzati per generare immagini e video falsi di abusi sessuali infantili. Se l’intelligenza artificiale è lo strumento che, in prospettiva preoccupa di più, nel presente sono molti altri i luoghi virtuali in cui gli abusi su minori si perpetuano. Dal 2020 al 2022 il report ha rilevato un aumento del 360% delle immagini sessuali autogenerate di bambini di 7-10 anni ma non meno pericolose sono le piattaforme di socialgaming, ampiamente frequentate dai minori. Lì, dove bambini e adolescenti dovrebbero solo divertirsi e chiacchierare di giochi e personaggi fantastici, le conversazioni rischiano di degenerare insituazioni di adescamento in un tempo medio di 45 minutima che possono verificarsi anche in soli 19 secondi. Una tempistica lampo facilitata da ambienti sociali caratterizzati da mescolanza tra adulti e minori, da uno scambio di regali virtuali e da un sistema di classifiche online pubbliche che aumenta significativamente la probabilità che due persone sconosciute entrino in contatto. Quando ciò avviene solitamente lo schema è sempre lo stesso: i predatori dopo aver stabilito un rapporto di fiducia con i minori li manipolano, inducendoli a condividere con loro immagini e video a sfondo sessuale. Il passo successivo spesso, soprattutto se le vittime sono ragazzi tra i 15 e i 17 anni, è l’estorsione sessuale a scopo di lucro, come svela la ricerca, passateda 139 segnalazioni nel 2021 a oltre 10.000 nel 2022. Il più delle volte gli adescatori si fingono ragazze e si rivolgono prevalentemente ai giovani attraverso i social media. Giovani che sotto ricatto non sempre riescono a reggere, e a volte finiscono per compiere su di sé azioni di autolesionismo che, nella più tragica delle situazione, possono condurre alla morte. Dal report è emerso anche che le piattaforme private sono il luogo in cui si verifica la maggior parte delle molestie e che spesso, esattamente come nella realtà,l’abusante non è una figura sconosciuta ma una persona della quale il bambino si fida. Chiunque è a rischio di finire nella rete ma in particolare le minoranze vulnerabili e i gruppi emarginati, sia a livello sessuale, sia di etnia o disabilità. Per invertire la tendenza e fare in modo che sempre meno bambini subiscano abusi online è necessario l’impegno di tutte le parti interessate, ovvero governi, fornitori di servizi online e organizzazioni della società civile, che dovrebbero focalizzarsi su alcuni punti fondamentali, a partire dalla prevenzione, con l’investimento in interventi mirati a coloro che hanno o rischiano di commettere o subire abusi, senza limitarsi a rispondere al problema dopo che l’abuso è avvenuto. Fondamentale anche progettare interventi che sensibilizzino i bambini, facilitando l’identificazione degli abusi. E ancora, impedire che gli autori dei reati sfruttino scappatoie legali, emanare norme coerenti a livello globale e implementare approcci innovativi alla progettazione tecnologica che diano priorità alla sicurezza degli utenti fin dall’inizio e non a posteriori.