La fabbrica del dissenso

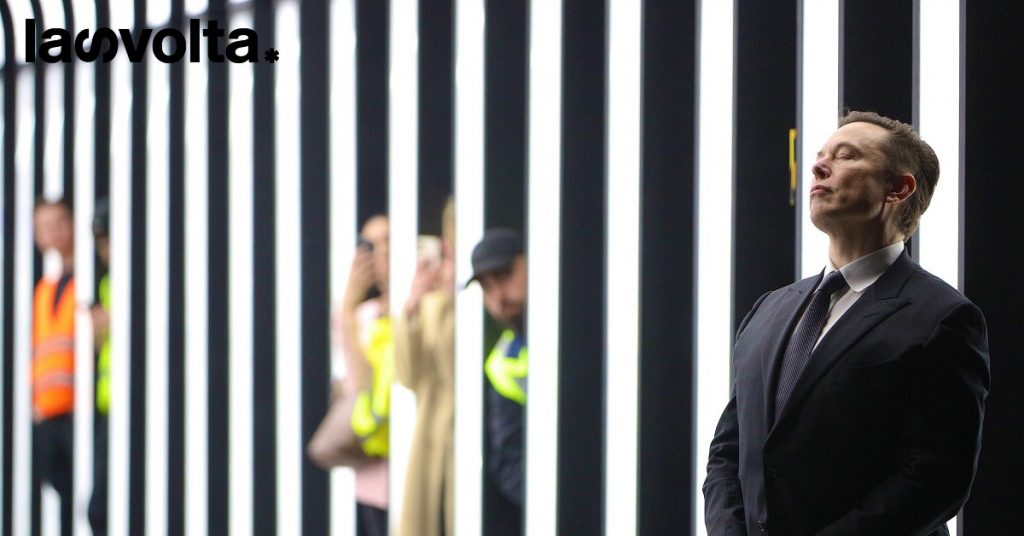

Twitter pone troppi limiti alla libertà di espressione, sospettaElon Musk, col supporto di un sondaggio da lui stesso organizzato. Il fondatore di Tesla e SpaceX si autodefinisceun assolutista della libertà di espressione. E in effetti esercita la sua capacità espressiva in modo assolutamente libero. L’ammirazione per la sua immagine, attestata anche dai suoi80 milioni di follower su Twitter, è costruita sul doppio binario della sua straordinaria abilità industriale e della sua evidente spregiudicatezza comunicativa. Che comprende annunci tecnologicamente molto “coraggiosi” anche se non necessariamente realistici,affermazioni finanziariamente poco ortodosse, battute politicamente radicali, e qualche importante incoerenza: come quando critica la politica della California in materia di accesso alle fabbriche nel quadro del contenimento della pandemia Covid-19, masi astiene dai commenti sulla politica ben più rigida della Cina sullo stesso argomento. Sta di fatto che, senza troppa trasparenza,Musk ha comprato quasi il 10% delle azioni Twitter ed è stato invitato nel board dell’azienda. E tutti si chiedono in che modo eserciterà la sua influenza sul modo di operare di una delle più importanti porte d’accesso all’informazione del Pianeta. In mancanza di un suo programma esplicito, non resta che aspettare di vedere i fatti. E prima di tutto dicomprendere se Musk userà il suo potere su Twitter pensando come un eccezionale industriale o come un bizzarro comunicatore. È lecito scommettere che inizierà sbagliando, ipotizzando che saprà correggersi velocemente, un po’come ha dimostrato di saper fare con SpaceX: all’inizio i razzi della sua azienda scoppiavano prima di partire, alla fine hanno imparato a volare molto bene. Certo è che questa sua nuova impresa è molto delicata. È un fatto chela qualità dell’informazionealla quale i cittadini del mondo possono accedere in questa fase di sviluppo dei media digitaliè tutt’altro che soddisfacente. La diffusione di notizie false, discorsi di odio, nuove forme di dipendenza, incomprensioni e banalizzazioni non cessa di preoccupare anche chi apprezza lafenomenale apertura di opportunità culturali e mediatiche generata dallo sviluppo di Internet. E in effetti non si ferma il dibattito su come questa situazione possa essere migliorata. Bisogna onestamente ammettere che il problema è complesso e chechiunque si presenti con una ricetta facile da applicare si illude, o vuole illudere. Ma alcuni punti di riflessione cominciano ad apparire più chiari: La fede nell’autoregolamentazionedelle piattaforme digitali, impostata dall’amministrazione di Bill Clinton e Al Gore, nella seconda metà degli anni Novanta del secolo scorso sta lasciando il passo alla convinzione che sia necessaria una maturazione delle regole che non può emergere senza un intervento politico.La logica prettamente americana secondo la quale il valore prioritario è la libertà delle transazioni, commerciali e informative, è chiamata ormai a confrontarsi con l’approccio europeo più orientato allasalvaguardiadi un equilibrio nell’insieme dei diritti delle persone.Il percorso avviato dalla Commissione europea è tutt’altro che facile da applicare sicché l’elaborazione diinnovazioni normativeva concepita tenendo conto dei suoi risultati, giuridici, ma anche operazionali e politici. La fede nell’autoregolamentazionedelle piattaforme digitali, impostata dall’amministrazione di Bill Clinton e Al Gore, nella seconda metà degli anni Novanta del secolo scorso sta lasciando il passo alla convinzione che sia necessaria una maturazione delle regole che non può emergere senza un intervento politico. La logica prettamente americana secondo la quale il valore prioritario è la libertà delle transazioni, commerciali e informative, è chiamata ormai a confrontarsi con l’approccio europeo più orientato allasalvaguardiadi un equilibrio nell’insieme dei diritti delle persone. Il percorso avviato dalla Commissione europea è tutt’altro che facile da applicare sicché l’elaborazione diinnovazioni normativeva concepita tenendo conto dei suoi risultati, giuridici, ma anche operazionali e politici. L’autoregolamentazione, comunque,ha raggiunto i suoi limiti. Quando Twitter e altre piattaforme hanno bloccato gli account dell’ex presidente degli Stati Uniti, Donald Trump, in seguito ai suoi interventi rivolti a incoraggiare l’invasione del Congresso americano da parte di gruppi di facinorosi, il 6 gennaio del 2021,i critici si sono divisitra coloro che sostenevano che l’intervento era tardivo e quelli che lo giudicavano illegittimo. Bisognava fermare Trump prima? Oppurenon si doveva intervenire per niente in nome della libertà di espressione? In realtà, quel dilemma era la dimostrazione del fatto chel’autoregolamentazione non funziona: perché affida un difficilissimo giudizio costituzionale a un insieme di persone ben più preparate a fare affari e programmi per computer che a operare scelte importanti per la qualità dell’informazione e per la democrazia. È solo un esempio. Come si interviene sulle espressioni di odio in rete?Come si giudica la diffusione di propaganda nemica durante una guerra? Chi ha la responsabilità delle sofferenze psicologiche e fisiche che possono derivare come conseguenza della diffusione di informazioni violente? Soprattutto,che effetti hanno i sistemi di intelligenza artificialeche intervengono nella gestione della conoscenza sulle piattaforme allo scopo di coinvolgere il pubblico e favorire il business? Gli algoritmi di raccomandazione hanno conseguenze sulla qualità dell’informazione e la diversità o radicalità delle opinioni che arrivano alle persone?Si tratta di una questione sistemica, che non cambia con il cambiamento dei membri del board delle piattaforme. La Commissione Europeaha affrontato il tema, appunto, in chiave sistemica.L’elenco degli interventi è ampio. La Dichiarazione dei diritti e dei principi digitali. Il Digital Markets Act e il Digital Services Act. L’Artificial Intelligence Act, il Data Governance Act e il Data Act.Il tutto nel quadro aperto dalla General Data Protection Regulation. E insieme alle normative, la Commissioneha lanciato investimenti e incentivazioniper l’economia digitale, l’alfabetizzazione digitale, l’innovazione digitale. La visione europea si fonda su una concezione ampia dei diritti delle persone che vanno bilanciati enon possono essere ridotti a una sorta di ipertrofia della libertà di espressione; prosegue nella convinzione che con le grandi piattaforme esistenti si debba instaurareun regime di co-regolamentazione(abbandonando dunque l’autoregolamentazione); si sviluppa nella prospettiva di incentivare la nascita di nuove piattaforme, più giuste e attente ai diritti. In questo sensol’Europa può fare la differenza, perché l’ampiezza del suo mercato non lascia indifferenti anche le compagnie basate in altri continenti. I problemi non mancano, peraltro: secondo le lobby americane e alcune imprese europee, tutto questo interventismo politico rischia di frenare l’innovazione. In realtà, l’Europa dimostra chel’innovazione tecnologica si cavalca e governa con l’innovazione normativa e di policy. Perché questa genera innovazioni metodologiche e imposta nuove modalità operative anche nell’industria. I risultati si devono valutare in rapporto al comportamento delle piattaforme esistenti e alla nascita e all’adozione dinuove piattaforme migliori. Per quest’ultimo argomento si fa notare una proposta che vieneda Oxford e Bologna, grazie al gruppo di ricerca di Luciano Floridi, Mariarosaria Taddeo, Matthias Holweg e altri,cheintende creare uno schema di lavoro per chi voglia sviluppare intelligenza artificiale con progetti eticamente avvertiti, seguendo le regole stabilite dalla Commissione Europea e senza rallentare il processo innovativo: il “capAI” prodotto dal gruppo di Oxford e Bologna èun manuale operazionale per valutare e monitorare la conformità dei progetti di nuove intelligenze artificialicon le direttive europee e i valori etici per tutto il ciclo del prodotto. È un punto di partenza che – come affermano gli stessi autori – può essere miglioratoper disegnare tecnologie eticamente solide senza fermare l’innovazione. È ovviamente orientato alla creazione delle prossime piattaforme. Il che non è tutto ma è strategico: qualsiasi successo duraturo della politica europea si dovrà valutarein base alla fioritura di spazi di informazione più sanidi quelli esistenti in rapporto alla qualità dell’informazione a disposizione dei cittadini. È una delle innovazioni che si affacciano all’attenzione su questa frontiera. E certamente altri strumenti andranno sviluppati per favorire la coregolamentazione impostata dalla Commissione, per sviluppare il dialogo tra le aziende e gli stakeholder,per garantire l’equilibrio tra la facilità di innovare e la sicurezza delle personein un contesto nel quale i loro diritti si confrontano con uno stato di guerra. Per tutte queste ragioni, Muskè benvenuto nel mondo dei media, come ha detto il ceo di Twitter, Parag Agrawal. Ma, soprattutto,se saprà imparare in fretta a esercitare il suo potere con equilibrio, nella consapevolezza della complessità dell’argomento. La prossima frontiera qui non è la conquista di Marte, ma qualcosa di più utopistico: dopo anni nei quali gli algoritmi e le interfacce delle grandi piattaforme hanno contribuito alla radicalizzazione delle opinioni diffuse nelle società occidentali, favorendo l’aggregazione di gruppi programmaticamente e assolutamente dissenzienti tra loro,la prossima frontiera è la costruzione di un terreno comunenel quale le opinioni si possano confrontare nel rispetto reciproco, cercando punti di sintesi. Perché non si torni alleforme di manipolazione tipiche dell’epoca della televisione, ma non si resti neppure paralizzati dalla disunione algoritmica dell’ultimo decennio. Le piattaforme digitali non sono necessariamente la fabbrica del dissenso.